Nous allons voir dans ce chapitre une importante application du chapitre précédent. Nous allons établir les formules permettant de calculer la droite de régression de y en x. Un nuage de points étant donné dans un repère, nous devons calculer l'équation de la droite passant le plus près possible de tous ces points.

Position du problème

Nous supposons qu’il existe une loi de proportionnalité (ou approximativement de proportionnalité) entre une variable y et une variable x. Des mesures expérimentales nous donnent un ensemble de couples (x,y) :

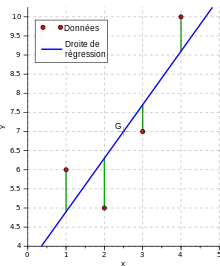

En reportant ces n mesures dans un repère, nous constatons que les points (en rouge sur le dessin) ne sont pas parfaitement alignés, cela étant dû, par exemple, à l'imprécision des mesures.

Nous allons, malgré tout, essayer de trouver une droite (en bleu sur le dessin) d'équation y = ax + b passant le plus près de tous les points.

Par « passant le plus près de tous les points », nous voulons dire telle que la somme des carrés des distances représentées en vert sur le dessin soit la plus petite possible. C'est pour cela que la droite de régression de y en x est aussi appelée : droite de régression des moindres carrés. La notion de distance qui nous intéresse ici correspond bien la notion de distance entre matrices étudiée dans les chapitres précédents.

Pour cela, nous faisons comme si la droite passait parfaitement par tous les points. Nous obtenons le système suivant :

et nous constatons que nous avons un système de n équations à deux inconnues a et b.

Résolution au mieux du système

Le système établi précédemment ayant beaucoup plus d'équations que d'inconnues, nous allons essayer de le résoudre « au mieux » comme nous avons appris à le faire dans le chapitre précédent.

Sous forme matricielle, le système précédent s'écrit :

D'après le théorème démontré au chapitre précédent, les nombres a et b qui satisfont au mieux le système précédent sont les racines du système obtenu en multipliant à gauche les deux membres par la transposée de la première matrice ; nous obtenons :

.

En effectuant les produits matriciels, nous obtenons :

- .

En traduisant cette dernière relation sous forme de système, nous obtenons :

En éliminant b de la première équation grâce à la deuxième, nous obtenons :

En divisant les deux membres de la première équation par n2 et les deux membres de la deuxième équation par n, nous obtenons :

La moyenne d'une série statistique x est donnée par :

- .

La variance d'une série statistique x est donnée par :

- .

La covariance d'une série statistique à deux variables x et y est donnée par :

- .

Compte tenu du rappel précédent, notre système peut s'écrire :

ce qui donne finalement :

Nous avons obtenu le résultat suivant :

Soit un nuage de points de coordonnées respectives (x1,y1), (x2,y2), ..., (xn,yn). La droite de régression de y en x, d'équation y = ax + b, passant le plus près des points du nuage, a ses coefficients qui vérifient :