Réseau de neurones de Hopfield

Le réseau de neurones d'Hopfield est un modèle de réseau de neurones récurrents à temps discret dont la matrice des connexions est symétrique et nulle sur la diagonale et où la dynamique est asynchrone (un seul neurone est mis à jour à chaque unité de temps). Il a été popularisé par le physicien John Hopfield en 1982[1]. Sa découverte a permis de relancer l'intérêt dans les réseaux de neurones qui s'était essoufflé durant les années 1970 à la suite d'un article de Marvin Minsky et Seymour Papert.

Un réseau de Hopfield est une mémoire adressable par son contenu : une forme mémorisée est retrouvée par une stabilisation du réseau, s'il a été stimulé par une partie adéquate de cette forme.

Structure

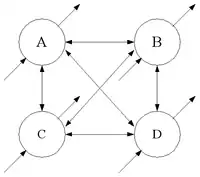

Ce modèle de réseau est constitué de N neurones à états binaires (-1, 1 ou 0, 1 suivant les versions) tous interconnectés. L'entrée totale d'un neurone i est donc :

où :

- est le poids de la connexion du neurone i au neurone j

- est l'état du neurone j

L'état du réseau peut être caractérisé par un mot de N bits correspondant à l'état de chaque neurone.

Dynamique

Le fonctionnement du réseau est séquencé par une horloge. On notera :

- ou l'état du neurone i à l'instant t

- l'état du neurone i à l'instant t + dt où dt désigne l'intervalle de temps entre 2 tops d'horloge

Il existe plusieurs alternatives assez équivalentes pour la mise à jour de l'état des neurones :

- Le mode stochastique original de Hopfield où chaque neurone modifie son état à un instant aléatoire selon une fréquence moyenne égale pour tous les neurones. Plus simplement on peut considérer qu'à chaque top d'horloge, on tire au hasard un neurone afin de le mettre à jour.

- Un mode synchrone où tous les neurones sont mis à jour simultanément.

- Un mode séquentiel où les neurones sont mis à jour selon un ordre défini.

Le calcul du nouvel état du neurone i se fait ainsi :

Apprentissage

L'apprentissage dans un réseau d'Hopfield consiste à faire en sorte que chacun des prototypes à mémoriser soit :

- Un état stable du réseau

- Un état attracteur permettant de le retrouver à partir d'états légèrement différents

Pour estimer les poids, on se sert d'un apprentissage hebbien, inspiré de la loi de Hebb (théorisée par Hebb en 1949 et observée réellement dans le cerveau par Bliss et Lomo en 1973). Donc l'une des représentations algébrique est :

- ,

où est le poids de la connexion entre le neurone et le neurone , est la dimension du vecteur d'entrée, le nombre de motif d'entraînement et et sont respectivement la ième entrée des neurones et .

L'apprentissage hebbien minimise la fonction d'énergie, c'est-à-dire que si deux unités sont actives simultanément, le poids de leurs connexions est augmenté ou diminué.

Limites

Le réseau de Hopfield a cependant des limites bien connues : il ne peut stocker qu'environ 0,14 n motifs avec n le nombre de neurones. Des modèles ultérieurs, s'inspirant du réseau de Hopfield mais en modifiant les règles de stockage et d'accès, permettent d'agrandir cette limite de stockage[2].

Voir aussi

Notes et références

- (en) J. J. Hopfield, « Neural networks and physical systems with emergent collective computational abilities », Proceedings of the National Academy of Sciences, vol. 79, no 8, , p. 2554–2558 (ISSN 0027-8424 et 1091-6490, PMID 6953413, DOI 10.1073/pnas.79.8.2554, lire en ligne, consulté le )

- Ala ABOUDIB, Vincent GRIPON et Xiaoran JIANG, « A study of retrieval algorithms of sparse messages in networks of neural cliques », COGNITIVE 2014 : the 6th International Conference on Advanced Cognitive Technologies and Applications, , p. 140–146 (lire en ligne, consulté le )

Articles connexes

Liens externes

- Neural Lab - interface graphique en Python et Gtk permettant de manipuler un reseaux de hopfield

- Portail de l'informatique théorique